特許から見たイノベーション企業ランキング

スイスに拠点を置くPatentSightが世界のデジタルイノベーション企業Top100のランキングを発表しました。このランキングは各企業が保有している質の高い特許に着目し作成されています。

このランキングの内訳を見ると、TOP100の中に、米国企業38社、中国企業21社に続き、日本企業が19社入っています。

なお、ランキングの1位はサムスンであり、日本企業は9位のSONYが最高位となっています。また、産業別ではロボティクス分野として、FANUCが1位となっています。

9位SONY 13位トヨタ 19位FANUC 22位デンソー 24位日立 27位パナソニック 30位三菱電機 33位キャノン 34位ホンダ 48位オリンパス 50位富士フィルム 61位リコー 65位NEC 72位東芝 78位日産 84位京セラ 86位アイシン精機 88位富士通 91位オムロン

(読書メモ)中国はなぜ軍拡を続けるのか

阿南東北大大学院教授の著書で、中国共産党と中国社会の関係を丁寧に描いており、非常に読み応えがあります。以下が概要です。

中国共産党は、そもそも格差是正を掲げて成立した政党であり、中国全土の土地、資源、工場、企業、インフラを接収し、計画経済で平等性の高い社会を構築することとしていました。しかし、毛沢東の個人独裁によりもたらされた大躍進運動と文化大革命により、共産党の党勢は弱体化します。

このため、鄧小平は一党支配体制を立て直すため、「改革開放」を導入して、資本主義諸国との貿易推進を図ります。しかし、改革開放の結果、共産党員に富が集中し、経済格差が拡がります。このため、胡耀邦と趙紫陽は共産党に富が集中しない制度(党と企業の分離)を実現しようとしますが、天安門事件を経て、計画は失敗し、経済格差の是正は実現できずに終わります。

その後、江沢民が国家主席となりますが、共産党の抱える経済格差という矛盾した問題に手を付けず、愛国主義教育を展開するなどの排外的ナショナリズムを高揚させ、軍拡路線を始めます。江沢民は行政経験も不足し軍歴もない人物であり、中国には国防を担う官僚もいなかったことから、江沢民の人民解放軍に対する影響は強くはありませんでした。この結果、江沢民は人民解放軍を政権側に引き留める措置として、軍上層部を既得権益側へ招きいれ軍拡を進めることとなります。このような背景もあり、江沢民以降の文民指導者と中国人民解放軍との関係は、共生やギブ&テイクの関係と言われます。

江沢民の後の胡錦涛は、富の再分配を目指し、国内の既得権益層に攻勢を仕掛けるととともに、対外協調路線をとります。国内の経済格差の責任を歴史に絡めて日米欧の責任に転嫁するのではなく、協調による実益の拡大を図り、社会保障改革等を進めました。しかし、江沢民をはじめとする既得権益層からの批判やリーマンショックもあり、富の再分配はうまくいきませんでした。

そして、後継者争いでは、江沢民の既得権益層との争いに負け、江沢民派の習近平が国家主席となります。習近平は、反腐敗を掲げつつも、既得権益構造を維持したままであり、中国の夢といった排外的ナショナリズムや個人独裁へ回帰しているように思われます。

表題の「中国はなぜ軍拡を続けるのか」との問いに対しては、作中、筆者は、共産党が暴力に依存する形で中国国内の民主化要求を抑え、民主化要求に共鳴して内政干渉をしかけてくる可能性のある西側諸国を牽制し、軍事力を誇示することで「中国民族の偉大な復興」を演出用としているとしております。

また、日米欧による対中政策については、天安門事件後の経済制裁解除により、既得権益層を残し、民主化勢力の弱体化を決定的にしてしまったと評価しています。確かに、当時は中国は西側諸国に依存するなかで、西側諸国の規範を受け入れていくという楽観的な思惑があったように思われますが、その思惑は外れ、結局は共産党を延命させることとなりました。

既得権益構造を改革するという点からは、現在、トランプ大統領が仕掛けている経済戦争は、トランプ大統領の思惑は違うかもしれませんが、中国の既得権益構造にメスを入れることになるかもしれません。

AIMイニシアティブ(THE AIM INITIATIVE)

インテリジェンス機関でもAI活用の動きが活発化しており、2019年1月、AIMイニシアティブが公表されました。ダン・コート情報長官によると、生み出されるデータや集積されるデータ量は爆発的に増加しているにも関わらず、情報を分析するインテリジェンスコミュニティー(IC)のスタッフが増加しているわけではない。人工知能、自動化技術、拡張技術を利用することにより、任務遂行能力を強化し、政策決定者への分析された情報を提供する能力を高めることを目的として、AIM(The Augmenting Intelligence using Machines:機械によるインテリジェンスの強化)イニシアティブは策定したとのことです。

特にAIMイニシアティブの策定には以下の3つの理由があったようです。

① AIや機械学習を扱う人材は限られており、新たなインセンティブや雇用モデルを作る必要がある。

② AIや機械学習には大量の高質なデータセットが必要であり、ルールやアルゴリズム、専門知識はすべての関係するミッションエリアに利用可能である必要がある

③ AI導入を急速に強化するため、ICは強固なデジタルの土台を持たなければならない。このため、IC技術への投資を行っていく必要がある。

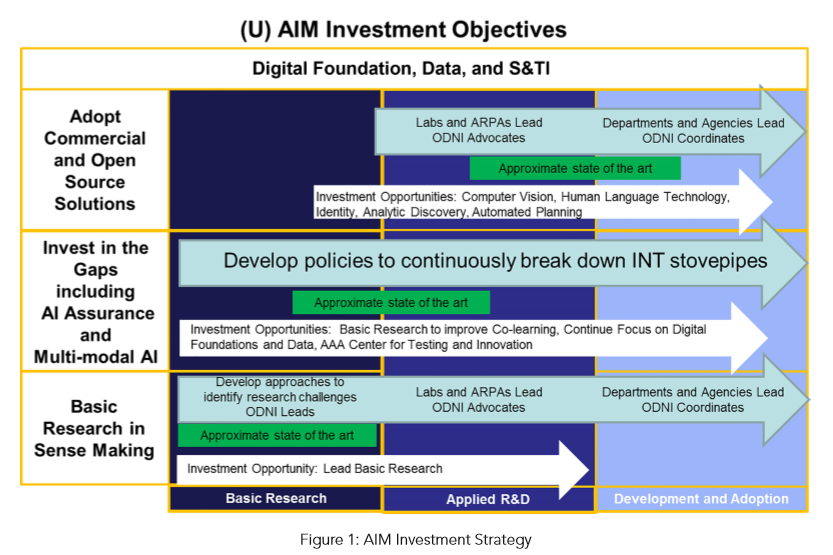

また、AIMイニシアティブでは、以下の4つの投資目標を定めています。

目的①(即座に実施):分析モデル構築のためのデータ作成、 データのラベリングの標準を構築等

目的②(短期的に実施):ICや産業界からAIや機械学習に精通したスタッフを集めAIMセンターの構築等

目的③(中期的に実施):戦略的なアドバンテージを維持するため、AIソリューションの開発等

目的④(長期的に実施):Sense-Makingに特化した基本研究へ投資

(参考)THE AIM INITIATIVE A STRATEGY FOR AUGMENTING INTELLIGENCE USING MACHINES

“虫の頭脳”を模した人工知能研究

DARPAは小さな虫の脳と同様に小さく効率的なコンピューティングシステムを構築する方法について研究を始めています。このMicroscale Biomimetic Robust Artificial Intelligence Networks(MicroBRAIN)プログラムは最終的には、より少ないデータで訓練され、より少ないエネルギーで作動する人工知能を作り出すことが目的です。人の脳のニューロンは600億~700億個であり、これを人工知能で模倣することはほぼ不可能ですが、虫の脳は1000個程度であり、マッピングが可能です。DARPAは虫の脳を研究することで、効率的な人工知能の開発に繋げようしており、そのために100万ドルのファンディングを用意しています。

(参考)DARPA Thinks Insect Brains Might Hold the Secret to Next-Gen AI

AIの導入方法ーAI Transformation Playbookー

Andrew Ng氏はAI時代にどのようにして企業を率いるかについて“AI Transformation Playbook”にて以下の5つを指摘しています。

① Execute pilot projects to gain momentum

② Build an in-house AI team

③ Provide broad AI training

④ Develop an AI strategy

⑤ Develop internal and external communications

Execute pilot projects to gain momentum(モメンタムを得るためにパイロットプロジェクトを行う)

最重要なAIプロジェクトよりは、まずはいくつかの簡単なAIプロジェクトを成功させることが大切です。会社内の他の従業員に対して、AIプロジェクトが投資するに値するものであると認識させる必要があるからです。なお、最初のAIプロジェクトは、外部のAIチームがあなたの会社のチームと協力しやすいプロジェクトであること、技術的に理解しやすいものであること、プロジェクトの成果が分かりやすいものであること、などが良いです。

Build an in-house AI team(社内のAIチームを構築)

最初は外部のAI専門家を招いてAIプロジェクトを行うことになると思いますが、長期的にはあなたの会社内のAIチームでAIプロジェクトを行うことが効率的になると思います。そのAIチームは、会社全体のAI能力の構築、様々な部署を横断的にAIにより支援、採用基準等の構築、会社全体のプラットフォームを構築(例えばデータの集約)などに責任を負うことになります。なお、AI人材の獲得は難しいことから、最初は外部のAI専門家と協力しつつ、既存のスタッフをトレーニングすることにより、AI人材を育てることが良い方法になります。

(参考)AI Transformation Playbookより

Provide broad AI training(幅広いAIトレーニングを実施)

AI人材を獲得することは難しいことから、社内人材を教育することが必要です。外部のAI専門家にAIプロジェクトをしてもらうというよりは、社内人材を指導しつつ、社内人材とプロジェクトを行うことにより、社内人材がAIの経験を積ませることが肝要です。

Develop an AI strategy(AI戦略の策定)

最初のAIプロジェクトを成功させ、AIへのより深い理解を得たならば、AI戦略の策定のプロセスに入ります。これは、AIに関する十分な経験がないと、AI戦略はうまくいかないため、最初からAI戦略の策定で始めることは好ましくないようです。AI戦略と合致するAIアセットの構築を行います。ただし、Googleのようなテック企業と競合するよりは、あなたの産業部門(製造業等)におけるAI企業となることが望ましいです。Googleのようなテック企業が保持しないデータを有する産業ならば、競争優位を保つことができます。また、データの蓄積が競争優位を保つために不可欠です。これがAIの好循環を構築することがAI戦略上大切です。なぜなら、AIはデータが鍵となるアセットだからです。そのためには、データをどう集めるかという観点と社内のデータをどう集約するかという観点が必要です。ただし、データは何でも良いというわけではなく、良いデータの集約が必要です。あまり価値のないデータの集約はAIプロジェクトを失敗に終わらせるため、どのようなデータの集約が必要かをAIチームとよく相談する必要があります。最終的にデータを集約するプラットフォームを作ることができれば勝者総取りになります。(これはプラットフォーマー問題でもあります)

Develop internal and external communications(内外とのコミュニケーションの展開)

最後に投資家、政府の規制、顧客(ユーザー)、人材獲得、社内コミュニケーションを行っていくことの重要性が指摘されています。

(参考)AI Transformation Playbook How to lead your company into the AI era

IoBTとは

IoT(Internet of Things)とは私たちの周りにあるあらゆるものがインターネットと結びつき、人を介さずして相互に制御しあうようなシステムであり、IoTの発展によりスマートハウスや自動運転などの新しいエコシステムが創出されつつあります。これと同じロジックが戦場にも適用されるとの考えから、戦場(Battlefield)におけるIoTということでIoBT(Internet of Battlefield Things)という概念が米陸軍研究所(US Army Research Laboratory)より発表されました。IoBTは兵士と防護服、無線、武器等に埋め込まれたスマートテクノロジーとを連結させることで、兵士に超感覚的知覚(extrasensory perception)、状況把握、予見力、高いリスク評価能力を与えることになります。IoBTは少しづつ現実になってきており、20~30年後には戦場において支配的な影響力をもたらすことになる可能性があります。

(参考)IoBT REIGN

(読書メモ)amazon―世界最先端の戦略がわかる―

成毛眞さんの著書。興味深い点は以下のとおり。

Amazonはマーケットプレイスに3億5千万以上の商品を有しており、外部の企業がこぞってマーケットプレイスを使用している。その理由は、Fulfillment by Amazon(FBA)と呼ばれるサービスであり、どのような企業でもAmazonのインフラを使用可能。すなわち、自社のECサイトがなくとも、Amazonが自社商品を海外も含めて販売してくれるため非常に魅力的。このため、多くの商品がAmazonに出品される。

マーケットプレイスは販売のプラットフォームであり、マーケットプレイスを通じてヒットした製品はAmazonも速やかに把握可能であることから、ヒット製品についてはAmazon自身も販売を開始することで利益を得ようとする。この際、Amazonは元々マーケットプレイスで付いていた値段よりも低価格で製品を提供するため、ヒット製品を出した企業は、Amazonと低価格競争せざるを得ず、これが玩具メーカーのトイザラスが倒産した要因の一つとも考えられる。

Amazonと楽天はビジネスモデルが全く異なり、楽天はネット上に仮想商店街を設けることで、出展企業からの手数料で稼ぐ一方で、Amazonは直販である。Amazonのビジネスモデルは、大量に仕入れ安く販売でき、別の種類のものをまとめて配送できるが、倉庫や在庫管理といった固定費がかかる。また物流網の構築にも時間と費用を要する。楽天の場合は、在庫をもつリスクはないが、出店企業ごとに販売するため、大量に安く仕入れることは難しく、商品が違えば配送がまとめられない。長い時間をかけて多額の投資により物流網を構築したAmazonと同様のことをすることは極めて難しい。

AmazonはIOT家電の囲い込みが始めており、Amazon Dash Replenishment Service(ADRS)として、消耗品が少なくなったタイミングでAmazonに自動的に注文する仕組みを構築。ADRSによりプリンターのトナーやインク、洗濯機の洗剤などが少なくなっていることを把握したIOT家電を通じて、注文なしに自動的に配達される。

Amazonは起業以来、株主に配当金を払っておらず、純利益が少ないことが特徴。ただしこれは、多額の投資を行っているから。また、仕入れた商品を販売し現金化されるサイクルであるCash Conversion Cycle(CCC)が大きなマイナスとなっており、物が売れる前から入金されている状態になっている。例えば、外部業者によりマーケットプレイスを通じて販売された商品の支払いはまずはAmazonが受け、手数料数%を差し引いて出展企業に返される。

Amazonが最も稼いでいるビジネスはAmazon Web Service(AWS)というクラウドサービスである。サーバの構築には巨額の費用と長年の時間を要する。また、構築したサーバも多額の維持費用がかかる。一方で、AWSを使用すれば、15分程度で数千台のサーバを使用可能になる。これまで自社サーバを持っていた企業もAWSを利用し始めており、CIAですら2013年に6億ドルで4年契約を結んでいる。日本でも三菱UFJ銀行がAWSを採用している。世界でクラウド化されているのは5%程度であり、残り95%をめぐって、マイクロソフトとGoogleがクラウドサービスに多額の投資を行っている。なお、Amazonがクラウドで強くなりすぎており、Amazonを敬遠する動きも出てきている。

AWSのデータセンターは世界で約53か所であり、今後12か所追加される予定。これは世界の4割のデータセンターをAmazonが持っているということになる。1つのデータセンターにかかる電力消費量は一般家庭1万世帯に相当し、データセンターのコストの半分は電力料金であることから、データセンターは寒冷地が好まれる傾向にある。なお、AWSで使われているサーバやルータ、通信制御半導体もAmazonが設計している。

無人コンビニとして話題になったAmazon GoはAmazonがプラットフォーマーである観点が重要。「作ったシステムを売る」ということがプラットフォーマーとしての条件であり、AmazonはAmazon Goの仕組みを売り出す可能性がある。Amazon Goで購入されたデータはAWSに収集され分析が行われ、品揃えや陳列を変更する等により多くの集客が見込まれる。したがって、もしこれが実現すれば、商店の多くがAmazon Goの仕組みを導入し始めると思われる。